Na corrida para trazer a inteligência synthetic para as empresas, uma pequena mas bem financiada startup está a fazer uma afirmação ousada: o problema que impede a adopção da IA em indústrias complexas nunca foram os próprios modelos.

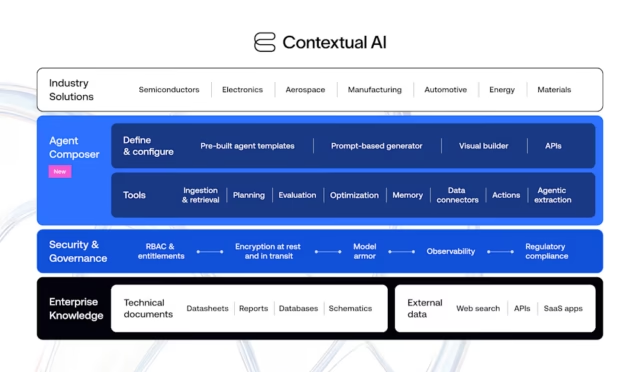

IA contextualuma empresa de dois anos e meio apoiada por investidores, incluindo Expedições de Bezos e Bain Capital Venturesrevelou na segunda-feira Agente Compositoruma plataforma projetada para ajudar engenheiros aeroespaciais, de fabricação de semicondutores e outros campos tecnicamente exigentes a construir agentes de IA que podem automatizar o tipo de trabalho intensivo em conhecimento que há muito resiste à automação.

O anúncio chega em um momento essential para a IA empresarial. Quatro anos depois de o ChatGPT ter desencadeado um frenesim de iniciativas corporativas de IA, muitas organizações continuam presas em programas piloto, lutando para transformar projetos experimentais em produção em grande escala. Os diretores financeiros e os líderes das unidades de negócios estão cada vez mais impacientes com os esforços internos que consumiram milhões de dólares, mas geraram retornos limitados.

Douwe KielaCEO da Contextual AI, acredita que a indústria tem se concentrado no gargalo errado. “O modelo está quase comoditizado neste momento”, disse Kiela em entrevista ao VentureBeat. “O gargalo é o contexto – a IA pode realmente acessar seus documentos proprietários, especificações e conhecimento institucional? Esse é o problema que resolvemos.”

Por que a IA empresarial continua falhando e o que a geração com recuperação aumentada deveria corrigir

Para entender o que IA contextual está tentando, ajuda a entender um conceito que se tornou central para o desenvolvimento moderno da IA: geração aumentada por recuperação, ou pano.

Quando grandes modelos de linguagem como os de OpenAI, Googleou Antrópico geram respostas, baseiam-se no conhecimento incorporado durante o treinamento. Mas esse conhecimento tem uma knowledge limite e não pode incluir os documentos proprietários, as especificações de engenharia e o conhecimento institucional que constituem a força very important da maioria das empresas.

Os sistemas RAG tentam resolver isso recuperando documentos relevantes dos bancos de dados da própria empresa e alimentando-os no modelo junto com a pergunta do usuário. O modelo pode então basear a sua resposta em dados reais da empresa, em vez de depender apenas da sua formação.

Kiela ajudou a ser pioneiro nesta abordagem durante seu tempo como cientista pesquisador na Pesquisa de IA do Facebook e mais tarde como chefe de pesquisa na Abraçando o rostoa influente empresa de IA de código aberto. Ele possui um Ph.D. de Cambridge e atua como professor adjunto em sistemas simbólicos na Universidade de Stanford.

Mas os primeiros sistemas RAG, reconhece Kiela, eram rudimentares.

“O RAG inicial period bastante rudimentar – pegue um retriever pronto para uso, conecte-o a um gerador e espere pelo melhor”, disse ele. “Erros agravados no oleoduto. As alucinações eram comuns porque o gerador não estava treinado para permanecer aterrado.”

Quando Kiela fundou IA contextual em junho de 2023, ele decidiu resolver esses problemas de forma sistemática. A empresa desenvolveu o que chama de “camada de contexto unificada” – um conjunto de ferramentas que fica entre os dados de uma empresa e seus modelos de IA, garantindo que a informação certa chegue ao modelo, no formato certo, no momento certo.

A abordagem ganhou reconhecimento. De acordo com um estudo de caso do Google Cloud, a Contextual AI alcançou o melhor desempenho no benchmark FACTS do Google para resultados fundamentados e resistentes a alucinações. A empresa aperfeiçoou os modelos Llama de código aberto da Meta na plataforma Vertex AI do Google Cloud, concentrando-se especificamente na redução da tendência dos sistemas de IA de inventar informações.

Por dentro do Agent Composer, a plataforma que promete transformar fluxos de trabalho complexos de engenharia em minutos de trabalho

Agente Compositor amplia a plataforma existente da Contextual AI com recursos de orquestração – a capacidade de coordenar várias ferramentas de IA em várias etapas para concluir fluxos de trabalho complexos.

A plataforma oferece três maneiras de criar agentes de IA. Os usuários podem começar com agentes pré-criados projetados para fluxos de trabalho técnicos comuns, como análise de causa raiz ou verificação de conformidade. Eles podem descrever um fluxo de trabalho em linguagem pure e permitir que o sistema gere automaticamente uma arquitetura de agente funcional. Ou eles podem construir do zero usando uma interface visible de arrastar e soltar que não requer codificação.

O que distingue o Agent Composer das abordagens concorrentes, diz a empresa, é sua arquitetura híbrida. As equipes podem combinar regras rígidas e determinísticas para etapas de alto risco – verificações de conformidade, validação de dados, portas de aprovação – com raciocínio dinâmico para análise exploratória.

“Para fluxos de trabalho altamente críticos, os usuários podem escolher etapas completamente determinísticas para controlar o comportamento do agente e evitar incertezas”, disse Kiela.

A plataforma também inclui o que a empresa chama de “otimização do agente com um clique”, que recebe o suggestions do usuário e ajusta automaticamente o desempenho do agente. Cada etapa do processo de raciocínio de um agente pode ser auditada, e as respostas vêm com citações em nível de frase mostrando exatamente onde as informações se originaram nos documentos de origem.

De oito horas a 20 minutos: o que os primeiros clientes dizem sobre o desempenho da plataforma no mundo actual

IA contextual diz que os primeiros clientes relataram ganhos de eficiência significativos, embora a empresa reconheça que esses números vêm de relatórios próprios dos clientes, e não de verificação independente.

“Isso vem diretamente de avaliações de clientes, que são aproximações de fluxos de trabalho do mundo actual”, disse Kiela. “Os números são relatados pelos próprios clientes, pois descrevem o cenário antes e depois da adoção da IA Contextual.”

Os resultados alegados são, no entanto, impressionantes. Um fabricante avançado reduziu a análise da causa raiz de oito horas para 20 minutos, automatizando a análise de dados do sensor e a correlação de registros. Uma empresa de especialidades químicas reduziu a pesquisa de produtos de horas para minutos usando agentes que pesquisam patentes e bancos de dados regulatórios. Um fabricante de equipamentos de teste agora gera código de teste em minutos, em vez de dias.

Keith Schaub, vice-presidente de tecnologia e estratégia da Advantestuma empresa de equipamentos de teste de semicondutores, ofereceu um endosso. “A IA contextual tem sido uma parte importante dos nossos esforços de transformação da IA”, disse Schaub. “A tecnologia foi implementada para diversas equipes da Advantest e para clientes finais selecionados, economizando um tempo significativo em tarefas que vão desde a geração de código de teste até fluxos de trabalho de engenharia do cliente”.

Os outros clientes da empresa incluem Qualcomma gigante dos semicondutores; NavioBobum fornecedor de logística capacitado para tecnologia que afirma ter alcançado uma resolução de problemas 60 vezes mais rápida; e Nvidiao fabricante de chips cujos processadores gráficos alimentam a maioria dos sistemas de IA.

O eterno dilema empresarial: as empresas deveriam construir seus próprios sistemas de IA ou comprá-los imediatamente?

Talvez o maior desafio IA contextual O que enfrenta não são os produtos concorrentes, mas o instinto das organizações de engenharia de construir suas próprias soluções.

“A maior objeção é ‘nós mesmos construiremos'”, reconheceu Kiela. “Algumas equipes tentam. Parece emocionante fazer isso, mas é excepcionalmente difícil fazer isso bem em escala. Muitos de nossos clientes começaram com DIY e ainda depuravam pipelines de recuperação em vez de resolver problemas reais 12 a 18 meses depois.”

A alternativa – soluções pontuais prontas para uso – apresenta seus próprios problemas, argumenta a empresa. Essas ferramentas são implementadas rapidamente, mas muitas vezes são inflexíveis e difíceis de personalizar para casos de uso específicos.

Agente Compositor tenta ocupar um meio-termo, oferecendo uma abordagem de plataforma que combina componentes pré-construídos com amplas opções de personalização. O sistema suporta modelos da OpenAI, Anthropic e Google, bem como o Grounded Language Mannequin da própria Contextual AI, que foi treinado especificamente para permanecer fiel ao conteúdo recuperado.

O preço começa em US$ 50 por mês para uso de autoatendimento, com preços corporativos personalizados para implantações maiores.

“A justificativa para os CFOs é realmente aumentar a produtividade e levá-los à produção mais rapidamente com suas iniciativas de IA”, disse Kiela. “Todas as equipes técnicas estão lutando para contratar os melhores talentos de engenharia, portanto, tornar as equipes existentes mais produtivas é uma grande prioridade nesses setores”.

O caminho a seguir: coordenação multiagente, ações de escrita e a corrida para construir sistemas compostos de IA

Olhando para o futuro, Kiela descreveu três prioridades para o próximo ano: automação do fluxo de trabalho com ações reais de gravação em sistemas corporativos, em vez de apenas leitura e análise; melhor coordenação entre múltiplos agentes especializados que trabalham em conjunto; e especialização mais rápida por meio do aprendizado automático com base no suggestions da produção.

“O efeito composto é importante aqui”, disse ele. “Cada documento que você ingere, cada ciclo de suggestions que você fecha, essas melhorias se acumulam. As empresas que estão construindo essa infraestrutura agora serão difíceis de capturar.”

O mercado empresarial de IA permanece extremamente competitivo, com ofertas dos principais provedores de nuvem, fornecedores de software program estabelecidos e inúmeras startups, todos perseguindo os mesmos clientes. Se a aposta da IA contextual no contexto em detrimento dos modelos dependerá de as empresas passarem a partilhar a visão de Kiela de que as guerras dos modelos básicos importam menos do que a infra-estrutura que as rodeia.

Mas há uma certa ironia no posicionamento da empresa. Durante anos, a indústria da IA concentrou-se na construção de modelos cada vez maiores e mais poderosos – investindo milhares de milhões na corrida pela inteligência synthetic geral. A IA contextual apresenta um argumento mais discreto: para a maior parte do trabalho no mundo actual, a mágica não está no modelo. Está em saber onde procurar.