Neste ponto, é seguro assumir que você usou um bot de bate-papo como Bate-papoGPT ou Gêmeos. Além de fazer perguntas gerais ou resumindo textos longosvocê também pode ter feito uma pergunta sobre saúde. Talvez você estivesse tentando descobrir se valia a pena se preocupar com um sintoma ou entender os resultados do laboratório, muitas vezes tarde da noite, quando um médico não está disponível.

Relatório da OpenAI de janeiro de 2026 descobriram que mais de 5% de todas as mensagens do ChatGPT em todo o mundo são sobre cuidados de saúde, e mais de 40 milhões de usuários ativos semanais em todo o mundo fazem perguntas sobre cuidados de saúde todos os dias.

(Divulgação: Ziff Davis, empresa controladora da CNET, em 2025 entrou com uma ação judicial contra a OpenAI, alegando que ela infringiu os direitos autorais de Ziff Davis no treinamento e operação de seus sistemas de IA.)

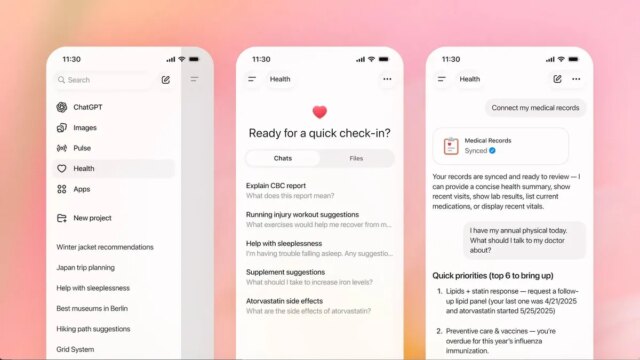

Em janeiro de 2026, OpenAI introduziu Saúde do ChatGPT para transformar esse hábito em um recurso dedicado. Esta “experiência focada na saúde” dentro do ChatGPT foi projetada para ajudá-lo a compreender informações médicas e a se preparar para conversas reais com médicos.

Não é uma ferramenta de diagnóstico ou tratamento.

Então, o que exatamente é ChatGPT Well being e como ele difere de perguntar a um bot de bate-papo uma pergunta aleatória de saúde? Vamos clicar duas vezes na nova guia Well being no ChatGPT.

O que é ChatGPT Saúde?

Saúde do ChatGPT não é um aplicativo separado como o seu Navegador de IAAtlas. Ele fica dentro do ChatGPT como um espaço ou aba dedicada, com foco em questões, documentos e fluxos de trabalho relacionados à saúde.

A guia Saúde no ChatGPT.

Na sua nota de lançamento, a OpenAI afirma que trabalhou com mais de 260 médicos que praticaram em 60 países e dezenas de especialidades ao longo de dois anos, revisando as respostas do modelo relacionado com a saúde mais de 600.000 vezes. Como resultado, ele não responde a nada que pareça médico da mesma forma aberta que um bate-papo regular. Em vez disso, responde de forma mais cautelosa, com limites mais rigorosos sobre a forma como a informação é explicada e instruções mais claras para procurar cuidados profissionais.

ChatGPT Well being está disponível na internet e no aplicativo móvel. Você não precisa baixar nada ou se inscrever fora do próprio ChatGPT. O acesso depende da localização e do estágio de implementação, mas você pode participar do lista de espera.

No início de 2026, está disponível nos EUA, Canadá, Austrália, partes da Ásia e América Latina, onde o ChatGPT já oferece suporte a recursos de saúde. Atualmente não está disponível na UE e no Espaço Económico Europeu, no Reino Unido, na China e na Rússia. A OpenAI disse que a disponibilidade aumentará, mas os prazos variam de acordo com a região devido aos regulamentos locais e regras de dados de saúde.

Como funciona o ChatGPT Well being

ChatGPT Well being usa o mesmo subjacente modelos de linguagem grande (LLMs) como ChatGPT. Você faz uma pergunta e o modelo gera uma resposta. A diferença com a Saúde é o contexto, a fundamentação e as restrições.

Alex Kotlarfundador da Bystro AIuma plataforma LLM focada em genética para insights de saúde, disse à CNET que a OpenAI não construiu um novo modelo de saúde basic.

“Eles não criaram um modelo que de repente entenda muito melhor os registros médicos. Ainda é o ChatGPT, apenas conectado aos seus registros médicos”, disse Kotlar.

O Well being se baseia nos dados que você escolhe sincronizar, mas não pode acessá-los, a menos que você conceda permissão explicitamente. Além de registros médicos, você pode conectar aplicativos como Saúde da maçãresultados de laboratório de registros de funções e alimentos de MyFitnessPal. Você também pode vincular Vigilantes do Peso para GLP-1 ideias de refeições, Instacart para transformar planos de refeições em listas de compras e Pelotão para recomendações de treino. Isso permite que a IA forneça insights personalizados com base no seu histórico, em vez de conselhos genéricos.

Essas conversas agora seguem regras mais rígidas em relação ao tom, origem e estilo de resposta, que a OpenAI afirma testar usando sua estrutura de avaliação. Banco de Saúde. Ele usa rubricas escritas por médicos para avaliar as respostas do modelo em 5.000 conversas simuladas sobre saúde, aplicando mais de 48.000 critérios específicos para avaliar a qualidade e a segurança.

Você pode enviar documentos para o Well being, usar comando de voz e fazer tudo o que normalmente faria em um chat regular. Se você estiver analisando vários resultados de testes ou se preparando para uma consulta com um especialista, o Well being poderá acompanhar o que você já compartilhou e ajudar a organizar as informações ao longo do tempo.

A OpenAI sugere usá-lo para revisar resultados de laboratório, organizar perguntas antes de uma consulta, traduzir a linguagem médica para o inglês simples e resumir documentos longos, como notas de alta ou explicações sobre seguros.

A OpenAI deixa explícito que a ferramenta se destina a apoiar conversas com profissionais de saúde, e não a encurtá-las. Não pode solicitar exames, prescrever medicamentos ou confirmar um diagnóstico. Se você o tratar como um médico, estará usando-o incorretamente.

Mas Dr.instrutor clínico da Stanford Well being Care e diretor médico da Átropos Saúdedisse à CNET: “Acho que a preparação e a educação em si já ultrapassam os limites do aconselhamento médico”.

O Well being mantém conversas, aplicativos conectados, arquivos e memória específica do Well being separados de seus bate-papos principais, para que os detalhes de saúde não retornem ao restante do ChatGPT. No entanto, o Well being pode usar a memória de bate-papos regulares. Digamos que você mencionou uma mudança recente ou mudança de estilo de vida, como se tornar vegano. A saúde pode aproveitar esse contexto para tornar a conversa mais relevante.

Ele também pode rastrear padrões ao longo do tempo. Se você conectar Saúde da maçãvocê pode perguntar sobre dormir tendências, padrões de atividade ou outras métricas e use esse resumo para conversar com seu médico.

ChatGPT Well being e ChatGPT para cuidados de saúde não são iguais

ChatGPT Well being é um recurso do consumidor para o bem-estar pessoal. Central de Ajuda da OpenAI diz que a HIPAA não se aplica a produtos de saúde de consumo como Well being. HIPAA é o Lei de Portabilidade e Responsabilidade de Seguro Saúdeque protege federalmente as informações confidenciais de saúde de um paciente contra divulgação sem o seu consentimento.

Separadamente, OpenAI oferece “ChatGPT para saúde“para organizações que precisam de controles projetados para uso clínico regulamentado e suporte para conformidade com a HIPAA, incluindo Acordos de Associados Comerciais (por exemplo, contratos entre prestadores de cuidados de saúde e empresas de cobrança).

Se estiver usando o ChatGPT Well being, você não estará entrando em um sistema hospitalar, mesmo que seus registros médicos possam ser conectados ao recurso. Você está usando um produto de consumo com proteções adicionais controladas pela OpenAI. Portanto, não presuma que “recurso de saúde” seja automaticamente igual a HIPAA.

Controles de privacidade e dados

A OpenAI afirma que o Well being adiciona proteções extras aos controles existentes do ChatGPT, incluindo “criptografia e isolamento específicos para manter as conversas sobre saúde protegidas e compartimentadas”.

Um porta-voz da OpenAI disse à CNET que as conversas e arquivos no ChatGPT são criptografados em repouso e em trânsito por padrão, e que o Well being adiciona proteções adicionais em camadas devido à natureza sensível dos dados de saúde. O porta-voz acrescentou que o acesso de qualquer funcionário aos seus dados de saúde seria limitado a operações de segurança e proteção, e que o acesso é mais restrito e limitado por finalidade do que os fluxos típicos de dados de produtos.

“Quando os consumidores ouvem que algo está criptografado, muitas vezes pensam que ninguém pode vê-lo. Não é assim que funciona. Criptografado em repouso não significa que a própria empresa não possa acessar os dados”, disse Kotlar.

Você pode desconectar aplicativos, remover o acesso a registros médicos e excluir memórias de saúde. Dane Stuckey, diretor de segurança da informação da OpenAI, também diz que as conversas sobre saúde não são usadas para treinar seus modelos básicos por padrão.

Ainda assim, “mais protegido que chats normais” não é o mesmo que isento de riscos. Mesmo uma segurança forte não consegue eliminar todos risco vinculado ao armazenamento on-line de informações confidenciais de saúde. Essa é uma das razões pelas quais a privacidade especialistas pediram aos usuários pensar cuidadosamente antes de enviar registros médicos completos para qualquer ferramenta de IA.

Limitações e preocupações de segurança

ChatGPT Well being pode ajudá-lo a entender as informações, mas ainda pode errar. Existe o risco de as pessoas considerarem as respostas da Well being pelo seu valor nominal. No mundo de hoje, todos querem respostas rápidas e a IA pode parecer convincente mesmo quando deveria ser cautelosa. Não é novidade que a ECRI (uma organização sem fins lucrativos de segurança do paciente) listou os chatbots de IA como os Padrão nº 1 de tecnologia de saúde para 2026.

Alucinaçõeso hábito da IA de produzir detalhes incorretos com confiança é muito mais importante nos cuidados de saúde do que quando você pede resumir um PDF. Se uma ferramenta fabrica completamente um estudointerpreta mal um valor de laboratório ou exagera o significado de um sintoma, você pode estar colocando seriamente sua saúde em risco.

“O maior perigo para os consumidores é que, a menos que tenham formação médica, terão dificuldade em avaliar quando está a dizer algo certo e quando está a dizer algo errado”, disse Kotlar.

Quando solicitado a comentar sobre as taxas de alucinações, o porta-voz da OpenAI disse que os modelos que alimentam o ChatGPT Well being “reduziram drasticamente” as alucinações e outros erros de alto risco em conversas médicas desafiadoras. De acordo com as avaliações internas do HealthBench da OpenAI, GPT-5 reduz em oito vezes as alucinações em cenários de saúde difíceis em comparação com modelos anteriores, reduz os erros em situações potencialmente urgentes em mais de 50 vezes em comparação com GPT-4o e não mostra falhas detectadas no ajuste ao contexto de saúde international.

A empresa também afirma que os seus modelos mais recentes são significativamente mais propensos a fazer perguntas de acompanhamento quando estão inseguros, o que, segundo ela, reduz o risco de respostas confiantes, mas incorretas.

“As empresas por trás dessas ferramentas precisam compartilhar que implementaram esse tipo de freios e contrapesos ou benchmarks para garantir que a qualidade da resposta seja alta”, disse Gombar à CNET.

A OpenAI afirma que a Saúde não se destina ao diagnóstico ou tratamento e deve apoiar, e não substituir, os cuidados dos médicos.

Kotlar diz que os cuidados de saúde são complexos e altamente regulamentados, pelo que ferramentas como esta podem ser “ótimas, mas ao mesmo tempo um pouco irresponsáveis”, uma vez que muita coisa ainda pode correr mal.

Você deveria usá-lo?

As pessoas já usavam o ChatGPT para questões relacionadas à saúde, mesmo quando não period o lugar certo para fazê-lo. Como o Well being adiciona proteções mais rígidas para tópicos médicos, pode ser um pouco mais seguro do que um bate-papo padrão para esse fim. Até médicos estão usando IA mais na prática, e esse uso quase dobrou entre 2023 e 2024, de acordo com a Associação Médica Americana, que entrevistou pouco mais de 1.100 médicos.

Gombar disse que as interações entre os cuidados de saúde tradicionais e a IA provavelmente vieram para ficar, mas acrescenta: “há espaço para melhorias e benefícios”. Muitas pessoas não tenho acesso confiável aos cuidados clínicos de rotina, e se os LLMs puderem pelo menos ajudar na triagem se alguém deve consultar um médico, isso por si só poderia ser significativo.

Se você tiver cuidado com os dados que compartilha, isso pode ser útil. Você pode usar o Well being para traduzir linguagem médica ou redigir perguntas para não congelar em uma consulta de 10 minutos. Você também pode fazer outras perguntas de baixo risco sobre dieta e exercícios. Apenas verifique sempre as informações com fontes confiáveis ou com um profissional. Nunca use-o para autodiagnóstico, decidir se deve tomar ou interromper a medicação ou interpretar um sintoma grave.

“Os cuidados de saúde não são como codificar ou escrever”, disse Kotlar. “Quando falha, falha de maneiras que são realmente perigosas para o ser humano.”

ChatGPT Well being pode ajudá-lo a entender as informações, mas não pode assumir a responsabilidade por sua saúde. Como a maioria das ferramentas de IA, seu valor depende de quão bem você entende seus limites.