Allen Institute for AI (Ai2) baru-baru ini merilis apa yang disebutnya paling kuat keluarga mannequin, Olmo 3. Namun perusahaan terus mengulangi mannequin tersebut, memperluas proses pembelajaran penguatan (RL), untuk menciptakan Olmo 3.1.

Mannequin Olmo 3.1 baru berfokus pada efisiensi, transparansi, dan kontrol bagi perusahaan.

Ai2 memperbarui dua dari tiga versi Olmo 2: Olmo 3.1 Assume 32B, mannequin andalan yang dioptimalkan untuk penelitian tingkat lanjut, dan Olmo 3.1 Instruct 32B, dirancang untuk mengikuti instruksi, dialog multi-putaran, dan penggunaan alat.

Olmo 3 memiliki versi ketiga, Olmo 3-Base untuk pemrograman, pemahaman, dan matematika. Ini juga berfungsi dengan baik untuk melanjutkan penyempurnaan.

Ai2 mengatakan bahwa untuk meningkatkan Olmo 3 Assume 32B ke Olmo 3.1, para penelitinya memperluas proses RL terbaiknya dengan jadwal pelatihan yang lebih lama.

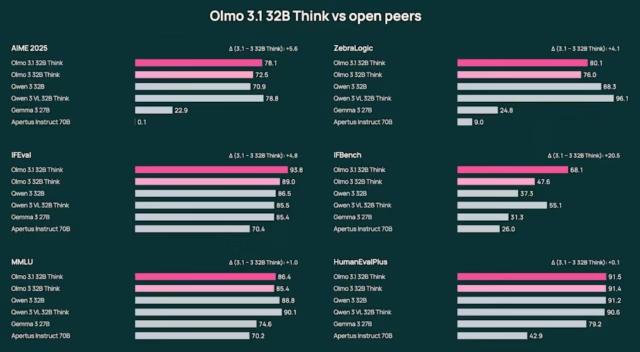

“Setelah peluncuran awal Olmo 3, kami melanjutkan pelatihan RL kami untuk Olmo 3 32B Assume, pelatihan selama 21 hari tambahan pada 224 GPU dengan periode tambahan pada kumpulan knowledge Dolci-Assume-RL kami,” kata Ai2 dalam sebuah postingan blog. “Hal ini menghasilkan Olmo 3.1 32B Assume, yang memberikan peningkatan substansial dalam tolok ukur matematika, penalaran, dan mengikuti instruksi: peningkatan 5+ poin pada AIME, 4+ poin pada ZebraLogic, 4+ poin pada IFEval, dan 20+ poin pada IFBench, di samping kinerja yang lebih kuat dalam pengkodean dan tugas multi-langkah yang kompleks.”

Untuk mencapai Olmo 3.1 Instruct, Ai2 mengatakan para penelitinya menerapkan resep di balik ukuran Instruct yang lebih kecil, 7B, ke mannequin yang lebih besar.

Olmo 3.1 Instruct 32B “dioptimalkan untuk obrolan, penggunaan alat, & dialog multi-putaran—menjadikannya saudara kandung Olmo 3 Instruct 7B yang jauh lebih berperforma dan siap untuk aplikasi dunia nyata,” kata Ai2 dalam sebuah posting di X.

Untuk saat ini, pos pemeriksaan baru tersedia di Ai2 Playground atau Hugging Face, dengan akses API segera hadir.

Performa lebih baik pada benchmark

Mannequin Olmo 3.1 berkinerja baik pada pengujian benchmark, diperkirakan mengalahkan mannequin Olmo 3.

Olmo 3.1 Assume mengungguli mannequin Qwen 3 32B pada benchmark AIME 2025 dan performanya mendekati Gemma 27B.

Olmo 3.1 Instruct memiliki kinerja yang kuat dibandingkan rekan-rekan sumber terbukanya, bahkan mengalahkan mannequin seperti Gemma 3 pada benchmark Math.

“Sedangkan untuk Olmo 3.1 32B Instruct, ini adalah mannequin instruksi yang disesuaikan dengan skala lebih besar yang dibuat untuk obrolan, penggunaan alat, dan dialog multi-putaran. Olmo 3.1 32B Instruct adalah mannequin obrolan terbuka penuh kami yang paling mumpuni hingga saat ini dan – dalam evaluasi kami – mannequin instruksi skala 32B terbuka penuh yang terkuat, “kata perusahaan itu.

Ai2 juga meningkatkan mannequin RL-Zero 7B untuk matematika dan pengkodean. Perusahaan mengatakan pada X bahwa kedua mannequin mendapat manfaat dari pelatihan yang lebih lama dan lebih stabil.

Komitmen terhadap transparansi dan open supply

Ai2 sebelumnya mengatakan kepada VentureBeat bahwa mereka merancang rangkaian mannequin Olmo 3 untuk menawarkan kontrol dan pemahaman lebih besar kepada perusahaan dan laboratorium penelitian tentang knowledge dan pelatihan yang dimasukkan ke dalam mannequin.

Organisasi dapat menambahkan campuran knowledge mannequin dan melatihnya kembali untuk belajar dari apa yang telah ditambahkan.

Hal ini telah lama menjadi komitmen Ai2, yang juga menawarkan a alat yang disebut OlmoTrace yang melacak bagaimana keluaran LLM cocok dengan knowledge pelatihannya.

“Bersama-sama, Olmo 3.1 Assume 32B dan Olmo 3.1 Instruct 32B menunjukkan bahwa keterbukaan dan kinerja dapat meningkat secara bersamaan. Dengan memperluas aliran mannequin yang sama, kami terus meningkatkan kemampuan sambil mempertahankan transparansi menyeluruh atas knowledge, kode, dan keputusan pelatihan,” kata Ai2.